本地調(diào)試作業(yè)

本文介紹Spark作業(yè)開發(fā)過(guò)程中,在本地上運(yùn)行Spark作業(yè)并進(jìn)行調(diào)試。

前提條件

已開通云原生多模數(shù)據(jù)庫(kù) Lindorm計(jì)算引擎的外網(wǎng)地址。

已將本地IP地址添加至Lindorm實(shí)例的白名單,具體操作請(qǐng)參見(jiàn)設(shè)置白名單。

已準(zhǔn)備Spark作業(yè)項(xiàng)目。

本地運(yùn)行Spark作業(yè)

已下載最新版Lindorm計(jì)算引擎環(huán)境的壓縮包,下載鏈接為環(huán)境壓縮包。

解壓下載的壓縮包,解壓的路徑可以自定義。

在本地配置計(jì)算引擎的環(huán)境變量,將解壓路徑設(shè)置為SPARK_HOME環(huán)境變量。

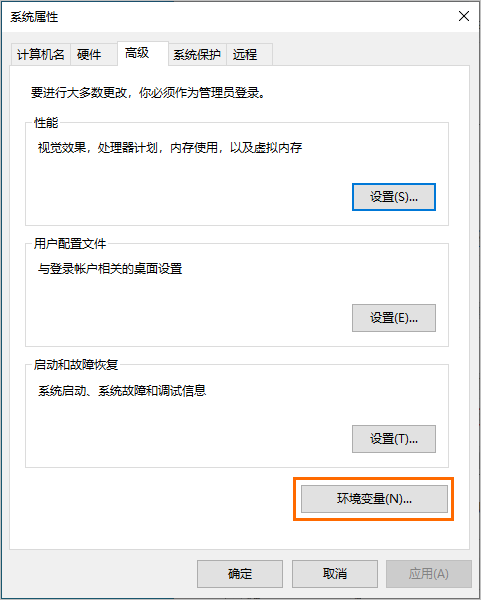

Windows系統(tǒng)配置計(jì)算引擎的環(huán)境變量步驟如下:

打開本地的系統(tǒng)屬性頁(yè)面并單擊環(huán)境變量。

在環(huán)境變量窗口,單擊系統(tǒng)變量區(qū)域下的新建。

在新建系統(tǒng)變量窗口,輸入以下參數(shù)。

變量名:填寫SPARK_HOME。

變量值:輸入壓縮包解壓的路徑。

單擊確定。

單擊應(yīng)用。

Linux系統(tǒng)配置計(jì)算引擎的環(huán)境變量,請(qǐng)執(zhí)行

export SPARK_HOME="<壓縮包解壓的路徑>"命令并將該命令添加至~/.bashrc中。

打包Spark作業(yè)項(xiàng)目,并使用$SPARK_HOME/bin/spark-submit提交Spark作業(yè)。作業(yè)提交示例如下。

以Spark作業(yè)示例為例,下載并解壓該項(xiàng)目。

配置以下參數(shù):

參數(shù)

參數(shù)值

說(shuō)明

spark.sql.catalog.lindorm_table.url

ld-bp1z3506imz2f****-proxy-lindorm-pub.lindorm.rds.aliyuncs.com:30020。

訪問(wèn)Lindorm寬表引擎的公網(wǎng)地址。請(qǐng)?zhí)顚慙indorm實(shí)例寬表引擎的HBase Java API公網(wǎng)訪問(wèn)地址,僅支持相同Lindorm實(shí)例的寬表引擎訪問(wèn)。

spark.sql.catalog.lindorm_table.username

默認(rèn)用戶名root。

訪問(wèn)Lindorm寬表引擎的用戶名。

spark.sql.catalog.lindorm_table.password

默認(rèn)密碼root。

訪問(wèn)Lindorm寬表引擎的密碼。

$SPARK_HOME/bin/spark-submit \ # 您可以通過(guò)使用 --jars 添加作業(yè)依賴jar包,更多參數(shù)請(qǐng)參考 spark-submit -h --class com.aliyun.lindorm.ldspark.examples.LindormSparkSQLExample \ lindorm-spark-examples/target/lindorm-spark-examples-1.0-SNAPSHOT.jar說(shuō)明提交Spark作業(yè)項(xiàng)目時(shí)如果不指定運(yùn)行方式,默認(rèn)是在本地上運(yùn)行,也可以通過(guò)spark.master=local[*]參數(shù)指定。

根據(jù)SQL代碼中涉及的Schema,創(chuàng)建對(duì)應(yīng)的庫(kù)表結(jié)構(gòu)。

使用

mvn clean package進(jìn)行作業(yè)打包。

完成作業(yè)的本地開發(fā)后,可以通過(guò)提交JAR作業(yè)的方式將Spark作業(yè)提交至云上運(yùn)行,具體操作請(qǐng)參見(jiàn)步驟一:依賴配置,請(qǐng)將Spark作業(yè)中使用的連接地址修改為L(zhǎng)indorm計(jì)算引擎的專有網(wǎng)絡(luò)連接地址。

調(diào)試Spark作業(yè)

以Spark作業(yè)示例為例,通過(guò)IDEA軟件調(diào)試Spark作業(yè)。IDEA軟件下載地址為官網(wǎng)IDEA。

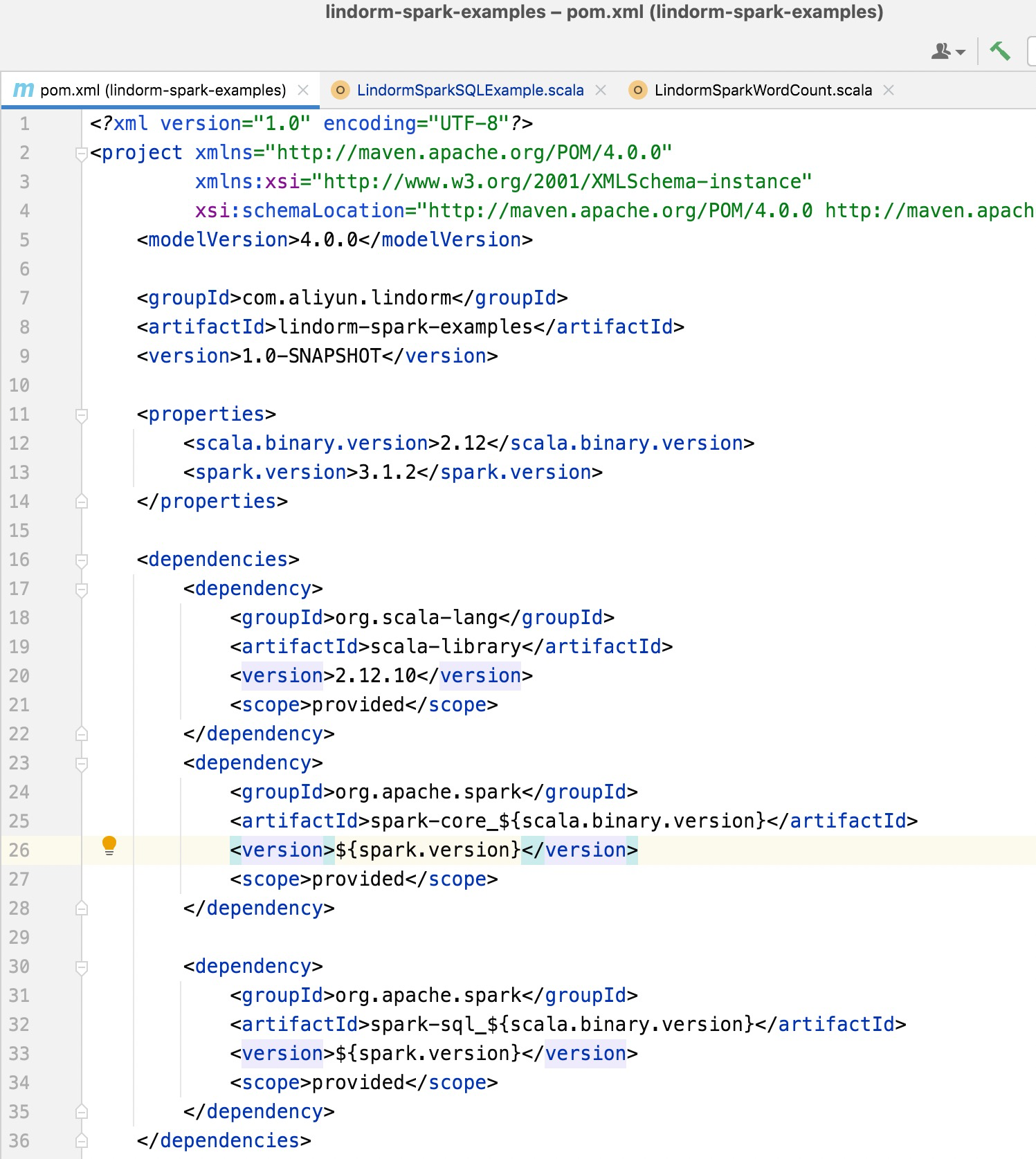

打開IDEA軟件,配置pom.xml文件中Spark相關(guān)依賴為

<scope>provided</scope>。

將$SPARK_HOME/jars添加至項(xiàng)目依賴中。

在IDEA軟件頂部菜單欄,選擇。

在左側(cè)導(dǎo)航欄,選擇,單擊+添加Java類庫(kù)。

選擇$SPARK_HOME/jars。

單擊OK。

運(yùn)行Spark作業(yè)程序。作業(yè)運(yùn)行過(guò)程中,您可以根據(jù)日志中指定的鏈接地址查看SparkUI。

2022/01/14 15:27:58 INFO SparkUI:Bound SparkUI to 0.0.0.0,and started at http://30.25.XX.XX:4040